IEEE | LLM Agent的能力边界在哪?首篇「图智能体 (GLA)」综述为复杂系统构建统一蓝图

IEEE | LLM Agent的能力边界在哪?首篇「图智能体 (GLA)」综述为复杂系统构建统一蓝图LLM Agent 正以前所未有的速度发展,从网页浏览、软件开发到具身控制,其强大的自主能力令人瞩目。然而,繁荣的背后也带来了研究的「碎片化」和能力的「天花板」:多数 Agent 在可靠规划、长期记忆、海量工具管理和多智能体协调等方面仍显稚嫩,整个领域仿佛一片广袤却缺乏地图的丛林。

LLM Agent 正以前所未有的速度发展,从网页浏览、软件开发到具身控制,其强大的自主能力令人瞩目。然而,繁荣的背后也带来了研究的「碎片化」和能力的「天花板」:多数 Agent 在可靠规划、长期记忆、海量工具管理和多智能体协调等方面仍显稚嫩,整个领域仿佛一片广袤却缺乏地图的丛林。

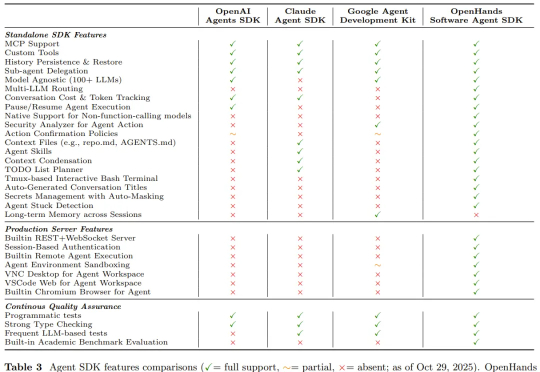

机器之心报道 编辑:Panda 刚刚,OpenHands 开发团队发布了一篇新论文,正式宣布广受欢迎的软件开发智能体框架 OpenHands (GitHub star 已超 6.4 万)中的智能体组件

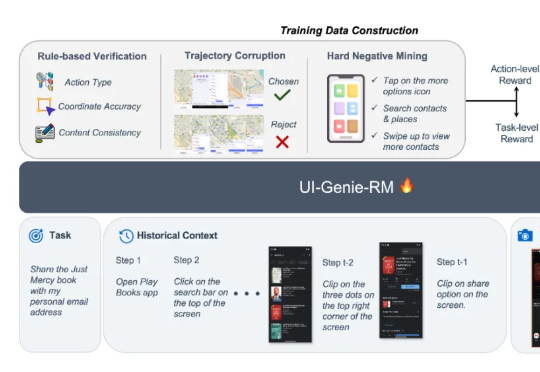

本文来自于香港中文大学 MMLab 和 vivo AI Lab,其中论文第一作者肖涵,主要研究方向为多模态大模型和智能体学习,合作作者王国志,研究方向为多模态大模型和 Agent 强化学习。项目 le

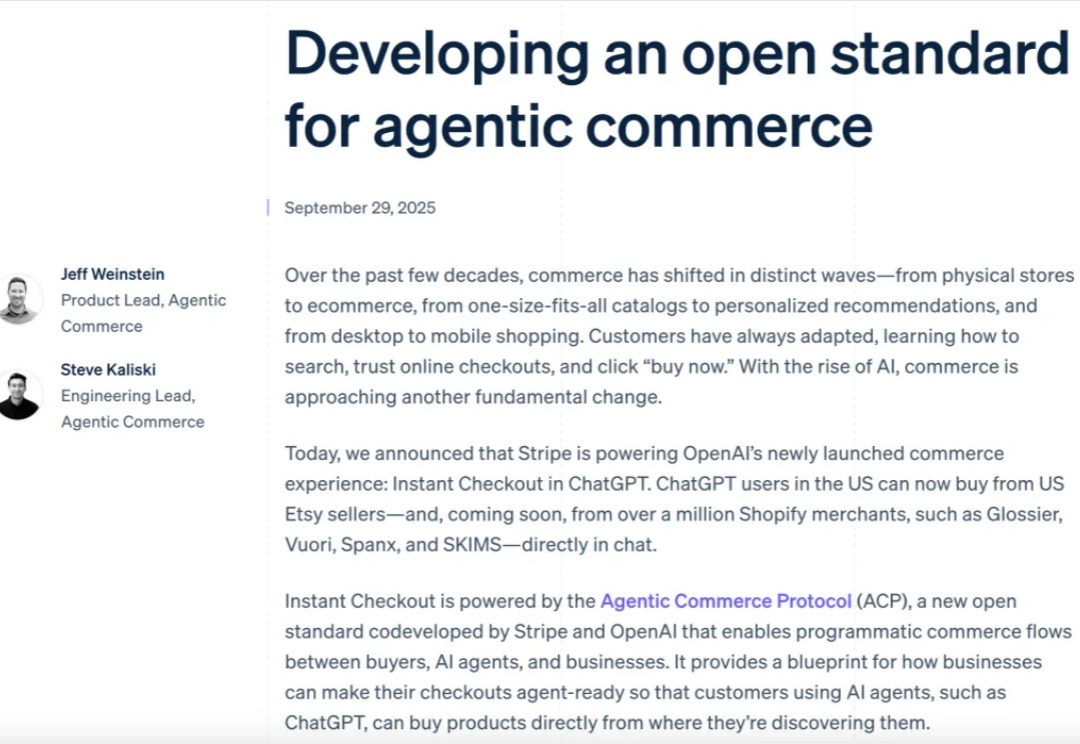

当 agent 开始学会“消费”,支付世界也迎来了重构的时刻。

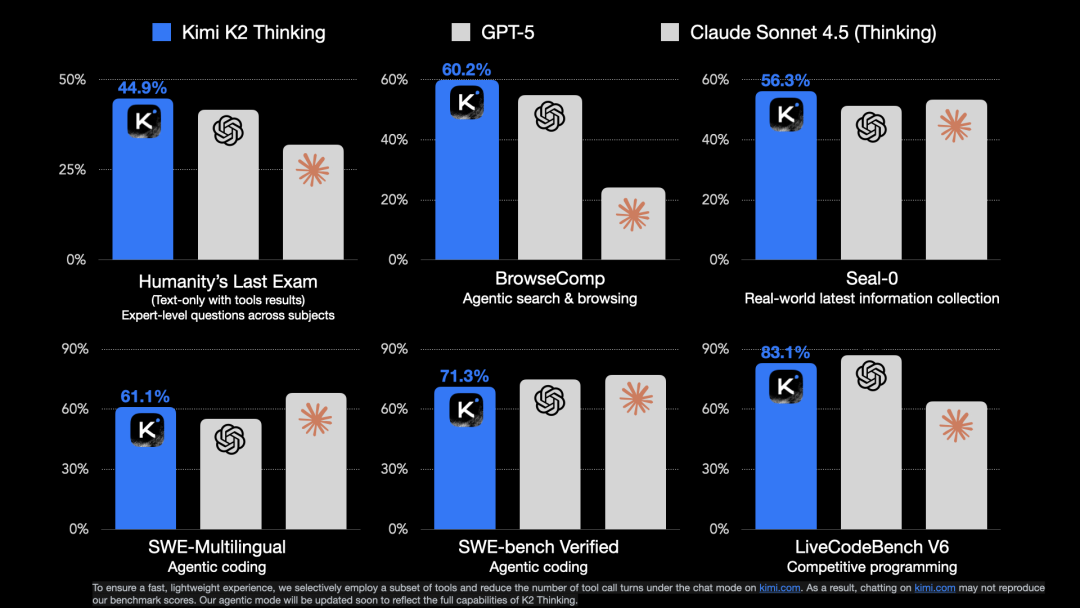

四个月前 Kimi 发布了 K2 模型,凭借优秀的质量以及先进的架构优化,一举打破了持续了几个月关于月之暗面的质疑。 我当时也写了两篇测评《Kimi K2 详测|超强代码和Agent 能力!内附Cla

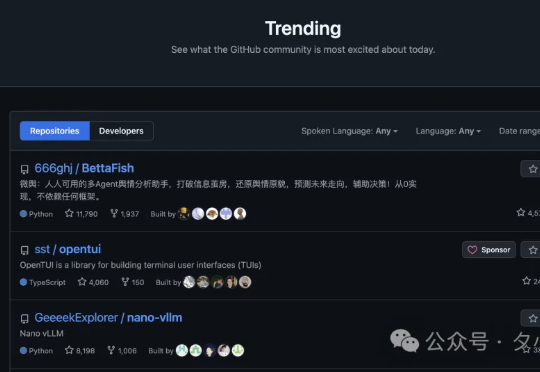

今天翻 GitHub Trending 的时候,看到一个不怎么眼熟的项目占据榜单第一。 仔细一看,是个多 Agent 舆情分析助手,名字叫「微舆 BettaFish」。再往下拉,发现它 star 已经过万了,而且还是最近十几天突然暴涨。

2025 年被广泛视为 AI 走向深度应用的关键元年,在这一年里,以多模态生成、Agent 为代表的 AI 技术不断探索更多样、更高效、更贴合用户需求的应用形态。其中重要性愈加凸显的一点是:AI 正在走向产业级价值的系统性兑现。

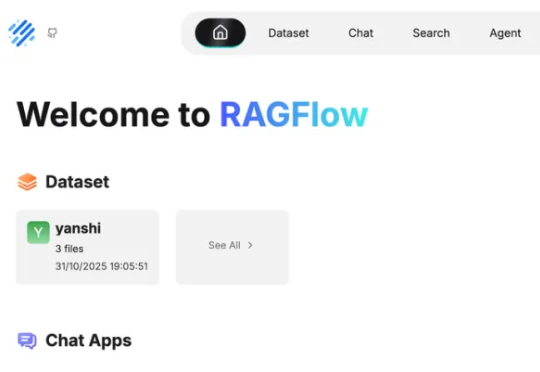

最开始,我们 CTO 计划选择 Coze,但查了下,Coze 整个项目还是比较大,而且后端是 Golang 编写的。我考虑了下,估计后续维护和开发对于中小团队来说比较吃力。各种权衡之后,我们选择了科大讯飞的 Astron Agent。主要原因有两个:

Voice Agent 赛道正在爆发,但它迫切需要一个能让对话真正「流动起来」的底层引擎,一个能撑起下一代交互体验的 TTS 模型。竞争的焦点,已经从 LLM 的「大脑」,延伸到了 TTS 的「嗓音」。谁掌握嗓音,谁就掌握着下一代 AI 商业化的钥匙。而 10 月 30 日 MiniMax 发布的 Speech 2.6 模型,似乎正是一个专为解决这些痛点而来的答案。

在 AI 与自动化方面,Block 在 2025 年初推出了一个名为 “Goose” 的开源 AI Agent 框架。Goose 的设计初衷是:将大型语言模型输出与实际系统行为(如读取/写入文件、运行测试、自动化工作流)连接起来,从而不仅让模型能“聊”而且能“干活“。